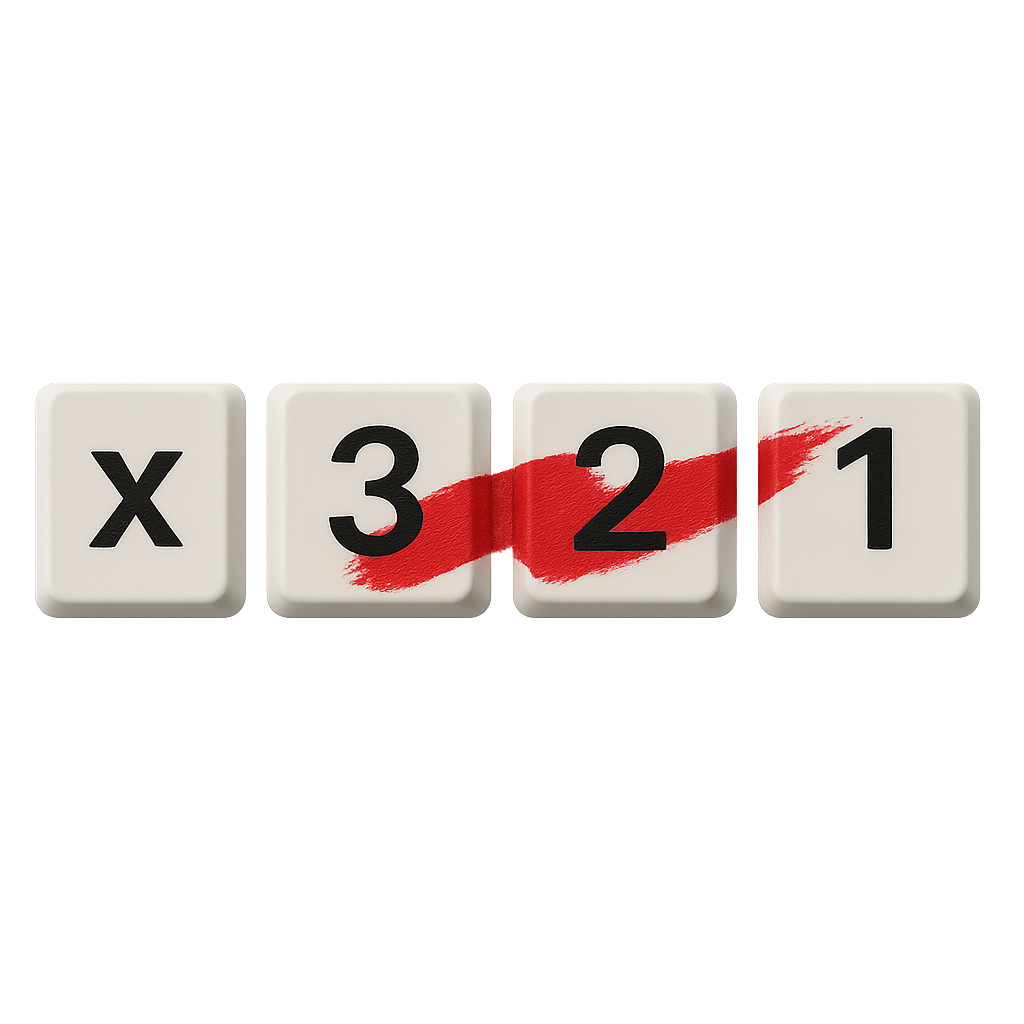

🤖 AI przyspiesza wdrożenia, ale generuje 1,7× więcej błędów

Raport wnosi cenne dane empiryczne o kompromisach jakościowych w programowaniu wspieranym przez AI, podkreślając potrzebę nowych procesów QA i przeglądów, które zapewnią bezpieczeństwo i trwałość kodu.

Raport CodeRabbit „State of AI vs Human Code Generation” przeanalizował 470 pull requestów open source na GitHubie, porównując kod tworzony przez sztuczną inteligencję i ludzi. Wyniki wykazały, że kod generowany przez AI zawiera średnio 1,7 razy więcej błędów, w tym więcej problemów logicznych, bezpieczeństwa, czytelności i wydajności. Autorzy przypisują te problemy brakowi kontekstu, słabemu dopasowaniu do lokalnych konwencji i powierzchownej poprawności generowanego kodu. Raport wskazuje strategie ograniczania ryzyka, takie jak lepsze formułowanie promptów, automatyzacja zasad jakości (policy-as-code), silniejsze zabezpieczenia i przeglądy kodu z uwzględnieniem specyfiki AI.

🔗Czytaj Więcej🔗

📜 History LLMs: modele trenowane wyłącznie na tekstach sprzed 1913 roku

🔗Czytaj Więcej🔗

🧩 headson: head/tail dla danych strukturalnych – podgląd JSON/YAML i kodu źródłowego

🔗Czytaj Więcej🔗

🎵 dogalog: środowisko muzyczne do livecodingu oparte na Prologu

🔗Czytaj Więcej🔗